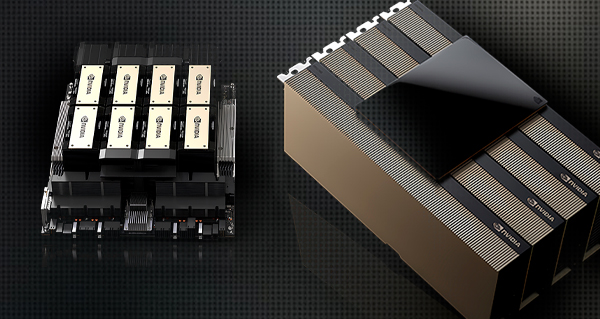

Видеокарта NVIDIA H200 NVL Tensor Core — это инновационное решение для корпоративных дата-центров, облачных AI‑кластеров и внедрения больших языковых моделей (LLM), которые требуют максимальной производительности и масштабируемости. Новинка объединяет два мощнейших ускорителя H200 в NVL‑конфигурации, чтобы обеспечить рекордную вычислительную плотность, энергоэффективность и скорость обмена данными для самых сложных задач искусственного интеллекта, HPC‑вычислений и генеративного AI.

NVIDIA H200 NVL построена на архитектуре Hopper с использованием памяти HBM3e и NVLink — это идеальный выбор для работы с LLM, GPT, больших нейросетей, а также для построения высокопроизводительных дата-центров и облачных сервисов, где требуется объединить множество графических ускорителей в единую вычислительную инфраструктуру. Благодаря поддержке FP8/FP16/BF16/TF32/FP64, расширенному ПО NVIDIA (CUDA, cuDNN, TensorRT, AI Enterprise) и интеграции с ведущими AI‑платформами, H200 NVL отлично подходит для сложных проектов: от обучения и инференса LLM до финансового моделирования, биоинформатики и генерации контента с помощью искусственного интеллекта.

Основные характеристики

- Архитектура: NVIDIA Hopper, Tensor Core 4‑е поколение

- Компоновка: 2 ускорителя H200 в NVL‑конфигурации

- Память: 2 × 141 ГБ HBM3e (до 9,6 ТБ/с на комплект)

- CUDA-ядер: 2 × 14 592

- Tensor-ядер: 2 × 456

- NVLink: до 900 ГБ/с скорость обмена

- Интерфейс: PCIe Gen5 NVLink Bridge

- FP8-производительность: до 8 PFLOPS (на комплект)

- Энергопотребление: до 1200 Вт

- Поддержка ПО: NVIDIA CUDA, cuDNN, NCCL, TensorRT, Triton Inference Server, AI Enterprise

Дополнительные характеристики

- Вычислительная плотность: компактное размещение, оптимизация пространства в стойке

- NVLink Bridge: обмен данными между двумя ускорителями без узких мест

- Масштабируемость: объединение до 8 NVL‑пар для построения AI‑кластеров

- Интеграция с облаком: готовое решение для виртуализации и корпоративных AI‑платформ

- Охлаждение: продвинутая система, рассчитанная на эксплуатацию в дата-центрах

Применение

- Запуск и обучение LLM: большие языковые и мультимодальные модели (GPT, GenAI)

- Машинное обучение и big data: ускорение тренировки, распределённый инференс

- HPC‑вычисления: биоинформатика, научное моделирование, финансовые расчёты

- Облачные платформы: виртуализация и масштабирование ИИ‑ресурсов

- AI‑генерация контента: реализация генеративных и нейросетевых сервисов

Если вы ищете NVIDIA H200 NVL GPU, Tensor Core H200 NVL, AI ускоритель нового поколения, видеокарту для LLM или графический процессор для современных задач искусственного интеллекта и вычислений, специалисты Азияторг помогут подобрать решение, интегрировать оборудование под ваш проект и обеспечить полную техническую поддержку.

Для индивидуального расчёта и консультации отправьте заявку на server@tkasiatorg.ru