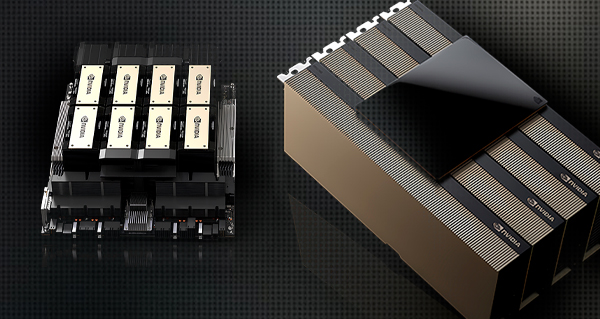

NVIDIA H200 Tensor Core GPU — это революционный графический ускоритель нового поколения для искусственного интеллекта, высокопроизводительных вычислений и машинного обучения. Данная новинка открывает новые горизонты в области AI-инфраструктуры, обеспечивая рекордную производительность и уникальную энергоэффективность для самых требовательных современных задач.

H200 Tensor Core построен на архитектуре NVIDIA Hopper, оснащён расширенной HBM3e-памятью и оптимизирован для глубокого обучения, генеративного AI, LLM, HPC и облачных дата-центров. Благодаря поддержке NVIDIA NVLink, PCIe Gen5 и программному стеку CUDA, ускоритель совместим с ведущими AI-фреймворками и легко масштабируется под проекты любой сложности. Модель H200 востребована для внедрения больших языковых моделей (LLM), ускорения нейросетей, научных симуляций, вычислительной биологии, финансового моделирования, генерации ИИ-контента и построения облачных платформ.

Основные характеристики

- Архитектура: NVIDIA Hopper

- Tensor Core: 4-е поколение, поддержка FP8/FP16/BF16/TF32/FP64

- Объём памяти: 141 ГБ HBM3e (пропускная способность до 4,8 ТБ/с)

- Ядер CUDA: 14 592

- Ядер Tensor: 456

- NVLink: поддержка 4-х ускорителей в одной системе, пропускная способность NVLink до 900 ГБ/с

- Интерфейс: PCIe Gen5, SXM5

- FP8/FP16/BF16 производительность: до 4 PFLOPS (FP8)

- TF32/FP64 производительность: до 1 PFLOPS (TF32)

- Энергопотребление: до 700 Вт (SXM), до 350 Вт (PCIe)

- Поддержка ПО: CUDA, cuDNN, NCCL, RAPIDS, TensorRT, Triton Inference Server

Дополнительные характеристики

- Вычислительная плотность: высокая эффективность для дата-центров и облака

- NVLink Switch System: масштабируемость для ИИ‑кластеров

- Глубокое обучение: ускорение обучения больших языковых моделей (LLM), генеративного AI, компьютерного зрения

- Интеграция: NVIDIA AI Enterprise, поддержка ведущих платформ виртуализации и автоматизации

- Охлаждение: поддержка жидкостного и воздушного охлаждения (зависит от конфигурации)

Применение

- Генеративный искусственный интеллект: запуск и обучение LLM, GPT, Transformer‑сетей

- Машинное обучение и Data Science: анализ больших данных, тренировка и инференс нейросетей

- Высокопроизводительные вычисления (HPC): научные симуляции, моделирование, биоинформатика, фармацевтика

- Облачные платформы и дата-центры: виртуализация ресурсов, построение ИИ‑кластеров и AI‑облаков

- Компьютерное зрение, обработка изображений и видео

- Финансовый анализ и моделирование

- Разработка и генерация ИИ‑контента

Если вы ищете NVIDIA H200 GPU, Tensor Core H200, AI ускоритель нового поколения, видеокарту для LLM или графический процессор Hopper H200 для современных задач искусственного интеллекта и вычислений, специалисты Азияторг помогут подобрать решение, интегрировать оборудование под ваш проект и обеспечить полную техническую поддержку. Для индивидуального расчёта и консультации отправьте заявку на server@tkasiatorg.ru